Các mô hình ngôn ngữ lớn (LLM) không chỉ đơn thuần là chatbot hay những công cụ tìm kiếm tiên tiến hơn thỉnh thoảng còn “ảo giác”. Thực tế, có rất nhiều ứng dụng cho LLM ngoài việc trò chuyện trực tiếp với chúng, đặc biệt là khi chúng được coi như một mô hình ngôn ngữ thực sự. Khi được triển khai dưới dạng LLM tự host (cục bộ), chúng có thể mang lại vô vàn lợi ích trong các bối cảnh năng suất, giúp ích đáng kể trong cuộc sống hàng ngày. Từ việc hỗ trợ tổ chức công việc đến làm cho mọi thứ trở nên dễ dàng hơn, đây là một số cách tôi đã sử dụng mô hình ngôn ngữ cục bộ để hỗ trợ bản thân.

5. Biến Obsidian thành công cụ ghi chú siêu việt

LLM cục bộ làm việc với ghi chú của tôi

LLM cục bộ kết hợp với Obsidian giúp quản lý ghi chú hiệu quả

LLM cục bộ kết hợp với Obsidian giúp quản lý ghi chú hiệu quả

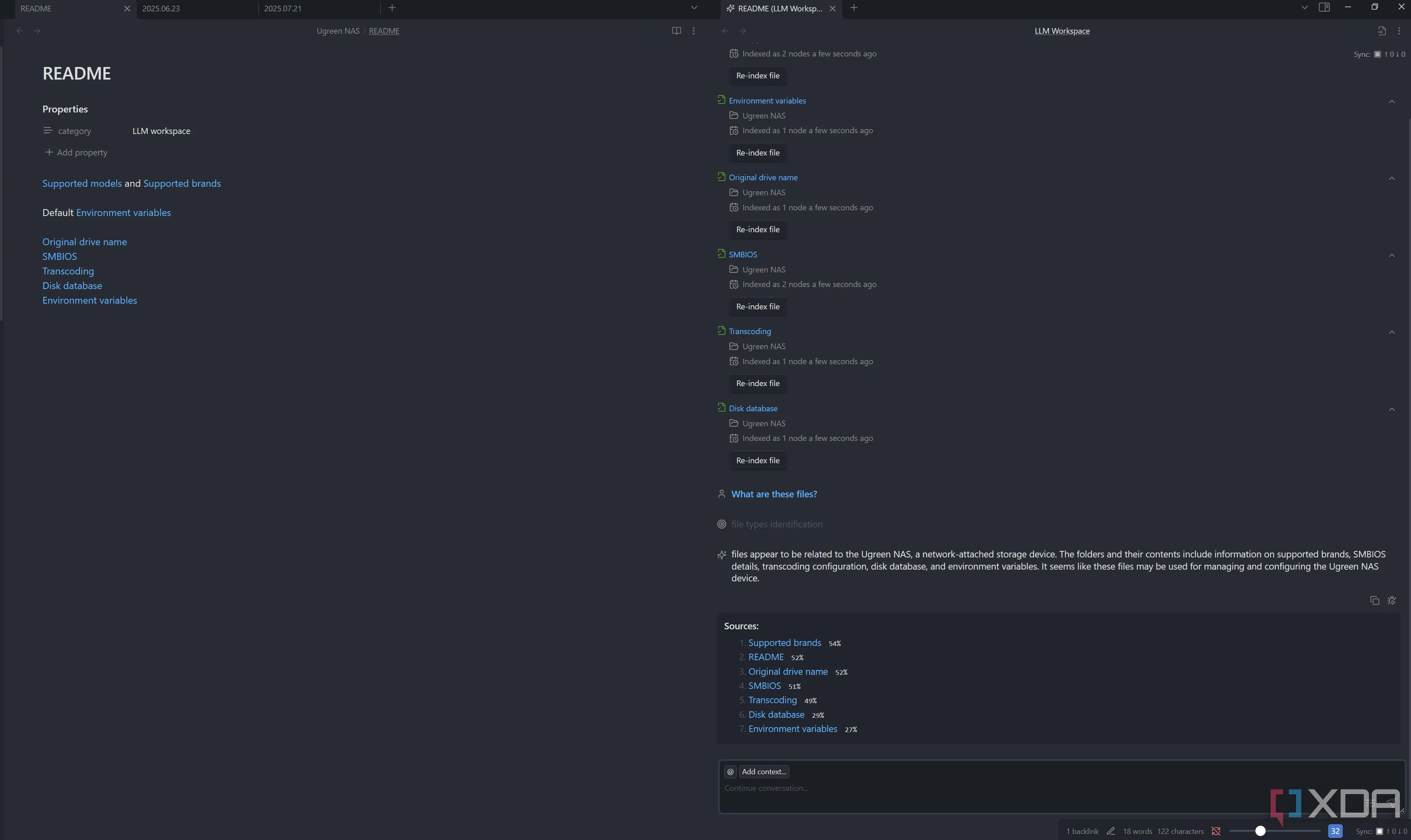

Tôi đã sử dụng Obsidian một thời gian khá dài và nó ngày càng trở thành trung tâm của cuộc sống số của tôi. Không chỉ tất cả các ghi chú liên quan đến công việc mà cả các dự án cá nhân, các thử nghiệm với home lab, và các dự án kỹ thuật đảo ngược của tôi cũng đều nằm trong đó.

Với sự hỗ trợ của một plugin tuyệt vời có tên “LLM Workspace“, bạn có thể tích hợp Obsidian với LLM tự host của mình. Chỉ cần định nghĩa một mô hình nhúng (embedding model) và một mô hình trò chuyện (chat model), sau đó tạo một “không gian làm việc” (workspace) với các liên kết đến các ghi chú khác của bạn. Từ đó, bạn có thể lập chỉ mục tất cả các ghi chú đó và truy vấn chúng trực tiếp từ giao diện Obsidian.

Lưu ý rằng đối với plugin này, phiên bản mới nhất trong kho plugin cộng đồng chưa hỗ trợ Ollama. Tôi đã phải tải xuống plugin từ GitHub và cài đặt thủ công, nhưng nó hoạt động hoàn hảo ngay sau khi tôi thiết lập. Tôi có thể truy vấn các ghi chú của mình và nhận được ý tưởng về cách mở rộng chúng, hoặc sắp xếp chúng một cách tốt hơn. Hơn nữa, không có lo ngại nào về quyền riêng tư dữ liệu, vì các ghi chú của tôi không bao giờ rời khỏi mạng gia đình.

4. Nâng cấp nhà thông minh qua Home Assistant

Tóm tắt ngày và báo cáo thời tiết tự động

Thông báo động từ Home Assistant hiển thị báo cáo thời tiết ngắn gọn do LLM tạo

Thông báo động từ Home Assistant hiển thị báo cáo thời tiết ngắn gọn do LLM tạo

Một LLM cục bộ hiện đang là xương sống cho toàn bộ thiết lập Home Assistant của tôi và cung cấp sức mạnh cho nhiều tự động hóa. Từ việc tóm tắt công việc tôi cần hoàn thành trong ngày đến các thông báo thời tiết tùy chỉnh, nó đã trở nên vô giá ở thời điểm này. Ngay cả trợ lý giọng nói cục bộ của tôi (nghe giống GLaDOS, rất đáng thử), cũng sử dụng mô hình Gemma3 27B IT QAT để cung cấp phản hồi nhanh chóng, chất lượng cao.

Đây là một trong những lợi ích tốt nhất của LLM, và nó thực sự rất, rất tuyệt vời. Tôi có thể đặt các câu hỏi dựa trên ngữ cảnh về nhà thông minh của mình mà không có bất kỳ phản hồi “định nghĩa trước” nào. Dù tôi hỏi liệu ngày mai có mưa không, liệu tôi có cần kem chống nắng hôm nay không, hay liệu trời có mưa sau 9 giờ tối không, tôi đều nhận được câu trả lời được cung cấp bởi dữ liệu thời tiết của mình, và mỗi lần đều độc đáo.

Tất cả những điều này không chỉ giúp tôi tiết kiệm thời gian mà còn giúp tôi dễ dàng nắm bắt thông tin trong ngày một cách tức thì. Tôi nhận được bản tóm tắt các cuộc gọi, khối lượng công việc và nếu tôi cần có mặt ở bất kỳ đâu, kèm theo thời tiết trong ngày. Ngoài ra, hãy nhớ rằng tôi đang sử dụng một mô hình khá mạnh cho trường hợp sử dụng này. Ngay cả một mô hình nhỏ 1B như Tinyllama hoặc một mô hình 7B cũng có thể hoàn thành công việc; tôi chỉ dùng Gemma3 cho gần như mọi thứ khác, vì vậy tôi cũng có thể dùng nó ở đây.

3. Continue.dev: Tiện ích mở rộng VS Code tuyệt vời

Hỗ trợ lập trình toàn diện

Giao diện Continue.dev tích hợp trong VS Code hỗ trợ lập trình hiệu quả

Giao diện Continue.dev tích hợp trong VS Code hỗ trợ lập trình hiệu quả

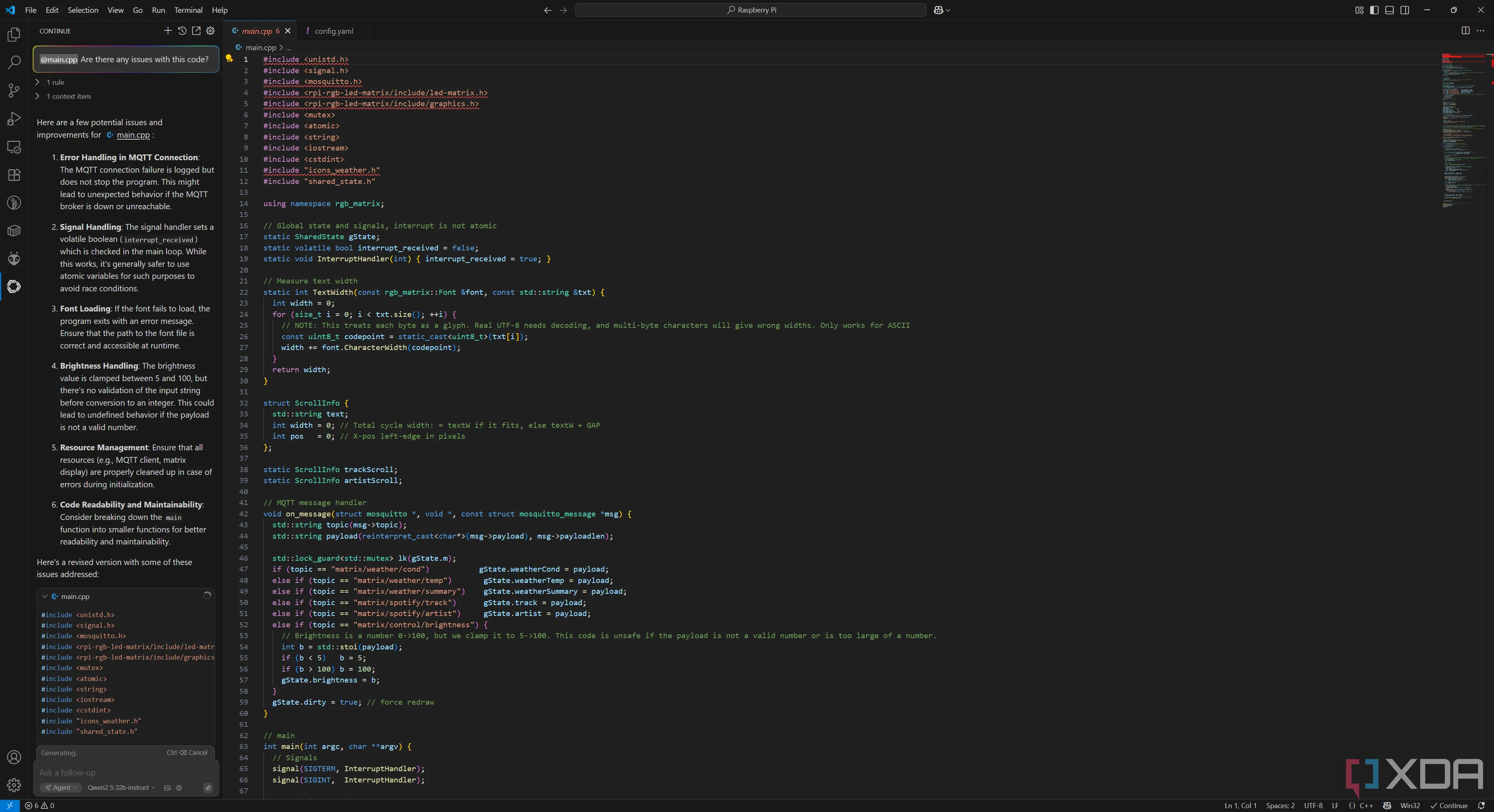

Chúng ta đều đã nghe nói về hiện tượng “vibe coding”, nhưng sự thật là LLM vẫn là một công cụ tuyệt vời để sử dụng như một phần trong quy trình làm việc lập trình của bạn. Đến mức các công cụ như OpenAI’s Codex, Gemini CLI và Claude Code đang tạo nên làn sóng trong không gian lập trình nhờ khả năng của chúng.

Để làm rõ, tôi sẽ không bao giờ dựa vào một LLM để thực hiện toàn bộ công việc lập trình cho mình, nhưng nó có thể rất hữu ích khi hỏi xem liệu có bất kỳ vấn đề nào với mã của bạn mà nó có thể phát hiện ngay lập tức, hoặc thậm chí sử dụng nó để bắt đầu cách tiếp cận một vấn đề. Rõ ràng bạn nên thực hiện một bài kiểm tra nhanh và đặt câu hỏi liệu phản hồi có ý nghĩa trong ngữ cảnh mã của bạn hay không, nhưng đó có thể là một cách tuyệt vời để bạn suy nghĩ về mã của mình theo những cách khác và những rủi ro tiềm tàng mà nó có thể gây ra. Continue.dev hoạt động với các mô hình từ xa hoặc cục bộ, và tôi trỏ nó đến phiên bản Ollama của mình với Qwen-2.5:32B-Instruct.

Ví dụ, tôi đã phát triển phần mềm của riêng mình để quản lý panel HUB75 64×32 Waveshare từ ESP32 và Raspberry Pi. Tôi có thể đơn giản hỏi, ngay trong VS Code, liệu có bất kỳ vấn đề nào với mã của mình không. Sau đó, nó sẽ phân tích và chỉ cho tôi những nơi có vấn đề tiềm ẩn, đồng thời đưa ra các giải pháp cho chúng. Nó thật tuyệt vời, và có thể đặc biệt hữu ích nếu tôi có một ngày “kém phong độ” khi lập trình hoặc tôi không quen thuộc với ngôn ngữ mà mình đang viết mã. Nó có thể không phát hiện mọi thứ, cũng như các gợi ý của nó có thể không đúng 100% mọi lúc, nhưng mỗi lỗi hoặc vấn đề cấp phát bộ nhớ mà nó phát hiện chính xác đều có nghĩa là một cải tiến tức thì cho mã của tôi.

2. Cải thiện cấu trúc Home Lab

Hiểu rõ những điều bạn chưa biết

Đôi khi, khi triển khai một phần mềm hoặc phần cứng mới, tôi cần một kế hoạch để cấu trúc cách triển khai nó. Tôi khá thành thạo về công nghệ và tự host, nhưng bản chất của việc không biết điều gì đó thường là bạn không biết điều gì bạn không biết.

Kết quả là, thật tốt khi tôi tìm đến LLM tự host của mình, nơi có chi tiết về home lab của tôi trong một cơ sở tri thức trên Open Web UI, và hỏi cách một triển khai sẽ hoạt động trong ngữ cảnh của phần cứng và phần mềm mà tôi đã sử dụng. Tôi không coi câu trả lời là câu trả lời chính xác 100%, nhưng khi bạn không biết điều gì bạn chưa biết, một thuật ngữ mới được đưa ra hoặc một kiến trúc tự host mà bạn chưa quen thuộc có thể thúc đẩy một loạt nghiên cứu về một chủ đề mới mà bạn chưa hề biết đến.

Khi nói đến LLM, cách tiếp cận “tin tưởng nhưng kiểm chứng” là một cách tiếp cận tuyệt vời, ngay cả khi “tin tưởng” là một từ hơi mạnh. Nó thường sẽ đưa bạn đi đúng hướng, nhưng chúng thường bỏ qua các chi tiết quan trọng. Hãy sử dụng nó như một công cụ tìm kiếm ngữ nghĩa; mô tả những gì bạn đang làm và sử dụng kết quả đầu ra để tự nghiên cứu về một chủ đề mà bạn có thể không quen thuộc. LLM nên là một công cụ giúp bạn tư duy hơn là thay thế hoàn toàn cho việc tư duy.

1. Sàng lọc email thông minh

Tóm tắt tức thì các email “quan trọng”

Tự động hóa thông báo gói hàng đã giao dựa trên email trong Home Assistant bằng LLM

Tự động hóa thông báo gói hàng đã giao dựa trên email trong Home Assistant bằng LLM

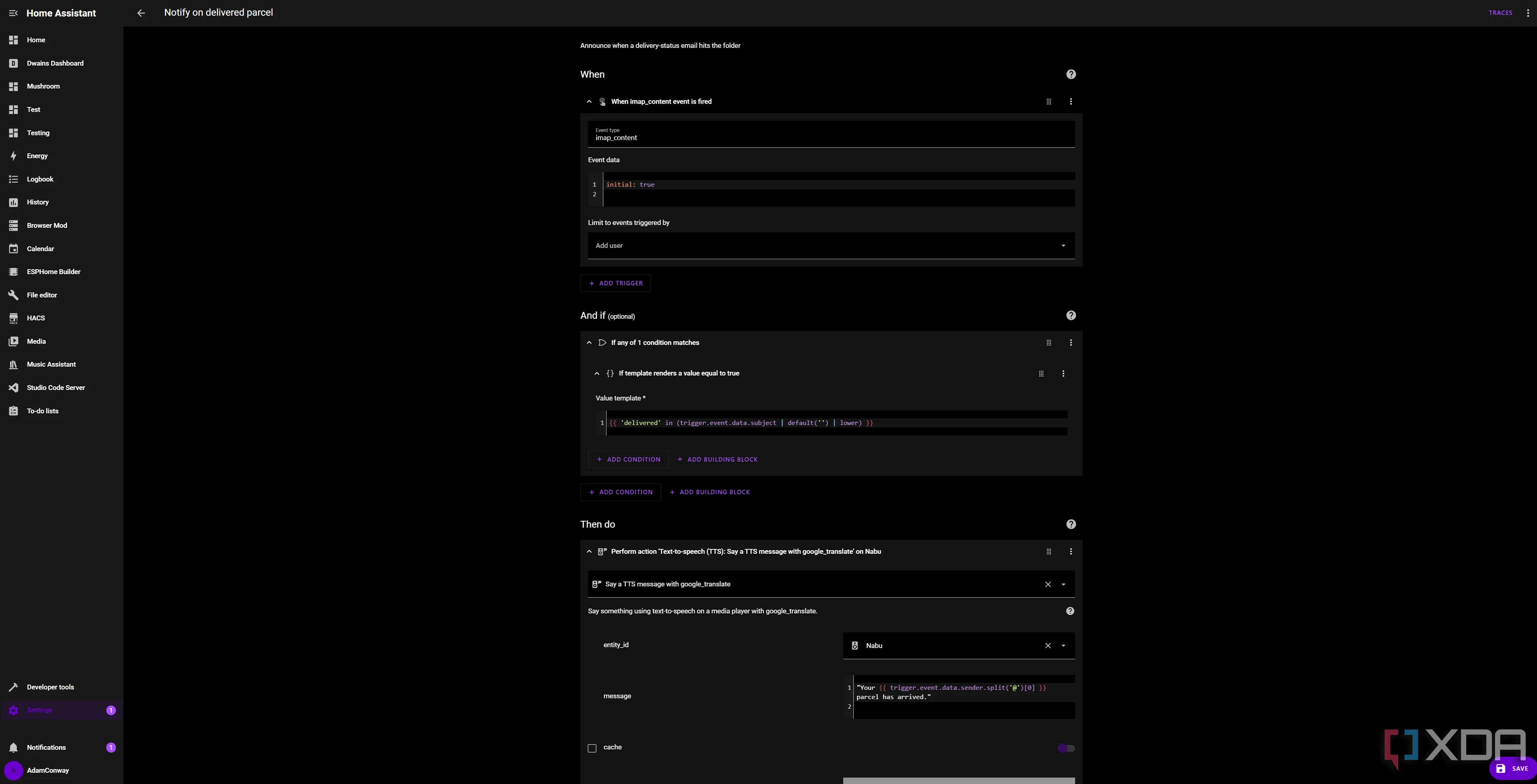

Đây là điều tôi đang thử nghiệm hiện tại, nhưng bằng cách sử dụng Home Assistant và Ollama, tôi đang cố gắng xây dựng một hệ thống phân loại để gắn cờ xem một email có nên được coi là “quan trọng” hay không, sử dụng tích hợp IMAP trong Home Assistant.

Thử nghiệm này cuối cùng có thể thất bại, nhưng ý tưởng khá đơn giản. Trích xuất nội dung email bằng Home Assistant, chuyển nó đến LLM cục bộ của tôi và nhận phản hồi dựa trên việc nó có đáp ứng các tiêu chí đã định trước của tôi hay không. Nếu có, nó sẽ hiển thị trên bảng điều khiển của tôi (sử dụng thẻ điều kiện) để tôi không bỏ lỡ. Tôi thậm chí có thể tóm tắt các email đã tích lũy cho đến nay.

Một LLM cục bộ là hoàn hảo cho việc này; tôi không muốn chia sẻ email của mình với OpenAI, và một giải pháp tự host khắc phục được vấn đề riêng tư tiềm ẩn này mà không ảnh hưởng đến hiệu suất. Một mô hình 27B là quá đủ cho tác vụ này, và nhiều mô hình nhỏ hơn cũng có khả năng tương tự. Về lâu dài, nó sẽ giúp tôi tiết kiệm thời gian, nhưng tôi vẫn đang thử nghiệm nó vào lúc này.

Tự host LLM tạo nên sự khác biệt

Chắc chắn, người ta có thể lập luận rằng ChatGPT và các LLM dựa trên đám mây khác rất tuyệt vời, nhưng sự thật là các mô hình cục bộ vẫn cực kỳ mạnh mẽ, và sức mạnh của các tùy chọn dựa trên đám mây đó, thành thật mà nói, là quá mức cần thiết khi so sánh. Tự host có nghĩa là tôi kiểm soát dữ liệu, ngữ cảnh và các tích hợp, và đó là điều quan trọng nhất đối với tôi. Bạn đã thử ứng dụng LLM tự host nào để tăng cường năng suất của mình chưa? Hãy chia sẻ kinh nghiệm của bạn trong phần bình luận bên dưới!