Nếu bạn đã sở hữu một hệ thống Home Lab hay nhà thông minh, có lẽ bạn đã không còn xa lạ gì với Home Assistant. Thậm chí, bạn có thể đã kết nối nó với một Trợ lý Giọng nói cục bộ để điều khiển các thiết bị thông minh mà không cần nhấc ngón tay. Với nhiều hệ thống tự động hóa đang hoạt động, sẽ thật tuyệt vời nếu bạn có thể trò chuyện với trợ lý giọng nói này một cách tự nhiên và có tính tương tác cao hơn. Thay vì phụ thuộc vào các loa thông minh từ những thương hiệu lớn, nơi bạn không có quyền kiểm soát dữ liệu cá nhân, bạn hoàn toàn có thể tự xây dựng một trợ lý giọng nói AI chạy cục bộ tại nhà. Hệ thống này không cần gửi dữ liệu về máy chủ bên ngoài, tích hợp sâu vào Home Assistant, và đặc biệt, cho phép bạn tạo ra một trợ lý AI với tính cách riêng, tùy chỉnh cho chính ngôi nhà thông minh của mình.

Tại sao cần một trợ lý giọng nói AI cục bộ cho nhà thông minh của bạn?

Các loa thông minh truyền thống từ những ông lớn trong ngành công nghệ thường đi kèm với một nhược điểm lớn: bạn không hoàn toàn kiểm soát dữ liệu giọng nói của mình. Mọi tương tác đều được xử lý trên máy chủ của họ, tiềm ẩn những lo ngại về quyền riêng tư. Giải pháp thay thế chính là việc vận hành AI giọng nói cục bộ ngay tại nhà, tích hợp với nền tảng Home Assistant mạnh mẽ. Để đạt được điều này, chúng ta sẽ kết hợp ba thành phần chính: Ollama để chạy các mô hình AI ngôn ngữ cục bộ, Whisper để chuyển đổi giọng nói thành văn bản, và Piper để chuyển văn bản thành giọng nói, hoàn thiện chu trình giao tiếp hai chiều giữa bạn và AI.

Tôi đã thử nghiệm chạy Ollama AI trên thiết bị NAS của mình, dù không có GPU để tăng tốc độ xử lý, nhưng đây là một minh chứng rõ ràng cho tiềm năng của ý tưởng này. Sau khi thấy hiệu quả, tôi dự định chuyển sang một máy chủ Proxmox vật lý với GPU Nvidia để tận dụng CUDA, giúp quá trình suy luận của AI nhanh hơn và mượt mà hơn. Đây không chỉ là một giải pháp thiết thực mà còn là một cái nhìn thú vị về tương lai của AI tác nhân, nơi giao diện tương tác giữa người và máy tính thực sự thông minh và linh hoạt, như những gì các fan Star Trek hằng mong đợi.

Giao diện trợ lý giọng nói AI cục bộ Home Assistant với các tùy chọn điều khiển nhà thông minh

Giao diện trợ lý giọng nói AI cục bộ Home Assistant với các tùy chọn điều khiển nhà thông minh

Lựa chọn cài đặt Home Assistant OS: Nhanh chóng và tiện lợi hơn Docker

Để thiết lập một trợ lý giọng nói AI cục bộ hiệu quả, bạn sẽ muốn liên kết Ollama (chạy mô hình AI cục bộ) và Whisper (mô hình chuyển giọng nói thành văn bản) để AI có thể hiểu được bạn. Để hoàn thiện cuộc trò chuyện, cần có thêm Piper, một mô hình chuyển văn bản thành giọng nói, giúp AI phản hồi lại bạn. Điều đáng ngạc nhiên là quá trình thiết lập này khá đơn giản, ngay cả khi đây là lần đầu tiên tôi sử dụng chatbot AI ngoài các phiên bản web như ChatGPT.

Tuy nhiên, có một điểm mấu chốt: tôi ban đầu cài đặt Home Assistant dưới dạng container Docker trên NAS, và đây là một cách làm “khó” khi muốn thêm các dịch vụ phức tạp. Giải pháp tối ưu hơn là cài đặt Home Assistant OS (HAOS) trực tiếp lên một Mini PC hoặc dưới dạng máy ảo. Lý do là phiên bản HAOS có một kho tiện ích (Add-on store) không có sẵn trên phiên bản Docker. Kho tiện ích này giúp việc cài đặt Whisper, Piper và Ollama trở nên cực kỳ dễ dàng, biến chúng thành một phần tích hợp của hệ điều hành Home Assistant. Nếu dùng Docker, bạn sẽ phải tự thiết lập từng container riêng biệt cho Whisper, Piper, Ollama và sau đó liên kết chúng vào Home Assistant, một quy trình phức tạp và tốn thời gian hơn rất nhiều.

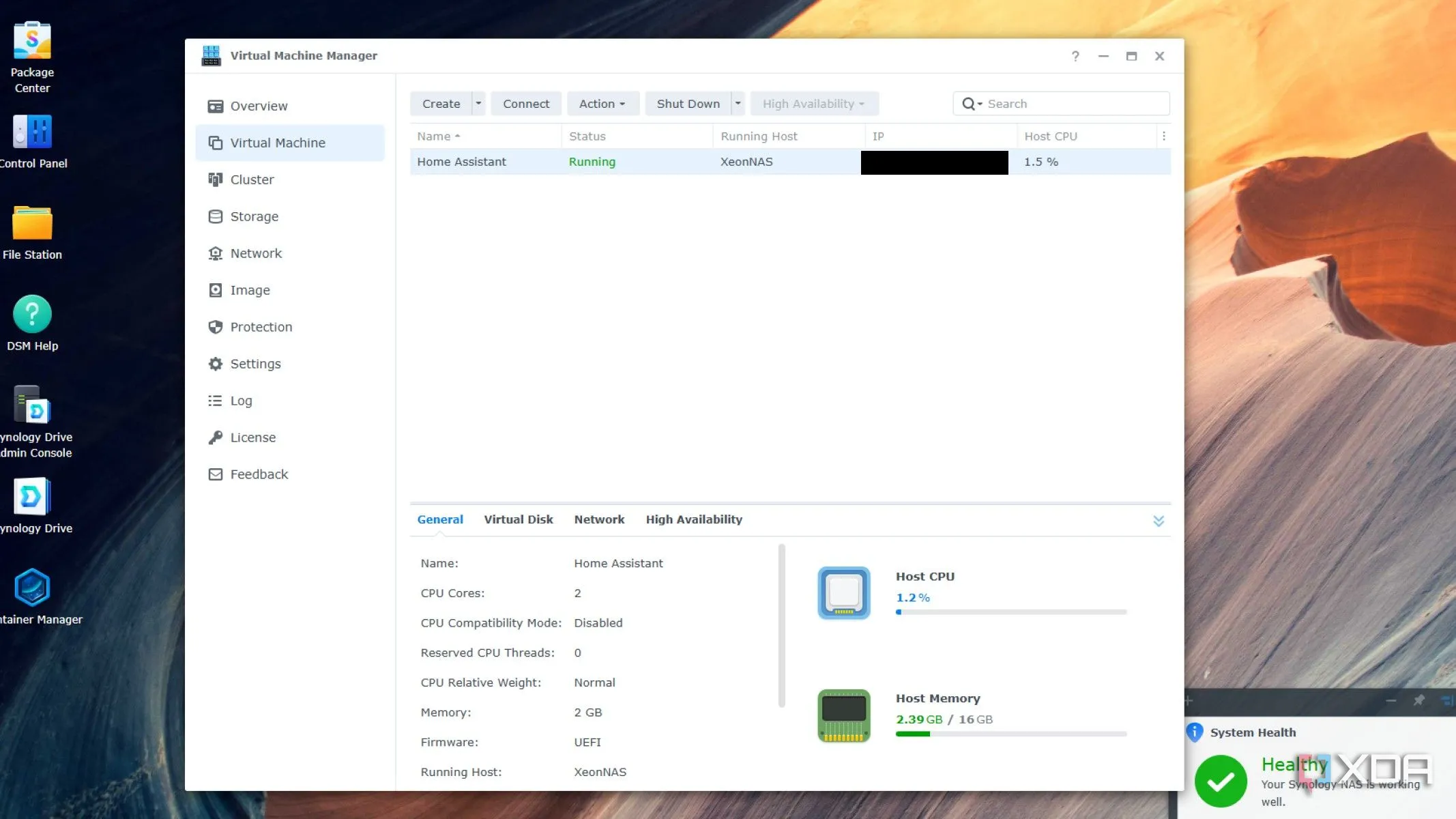

Màn hình quản lý máy ảo Synology DSM 7 hiển thị Home Assistant OS đang chạy

Màn hình quản lý máy ảo Synology DSM 7 hiển thị Home Assistant OS đang chạy

Sức mạnh và sự tiện lợi của mô hình AI cục bộ

Phần tốn thời gian nhất trong quá trình thiết lập này là chờ đợi mô hình Llama 3 tải xuống. Việc tích hợp nó vào HAOS, cũng như đưa Whisper vào hoạt động, lại khá đơn giản. Mặc dù tốc độ phản hồi hiện tại còn chậm và chưa thể thay thế hoàn toàn Alexa hay Google Assistant, nhưng điều này không còn quá xa vời. Thật ấn tượng khi các mô hình AI từng yêu cầu phần cứng máy chủ đáng kể giờ đây có thể chạy trên các thiết bị tiêu dùng.

Để thử nghiệm, tôi đã thiết lập Open UI để sử dụng Ollama thông qua văn bản. Dù quá trình này tốn khá nhiều thời gian và khiến quạt NAS của tôi chạy ầm ĩ hơn bất kỳ tác vụ nào khác, nhưng cảm giác được biết rằng quá trình suy luận đang diễn ra trên một thiết bị thuộc sở hữu của tôi, do tôi tự thiết lập tại nhà, thực sự mang lại một sự hài lòng đặc biệt. Mặc dù những công việc khó khăn về huấn luyện AI và phát triển các plugin cho HAOS đã được người khác thực hiện, nhưng tự tay đưa mọi thứ vào hoạt động vẫn là một thành tựu đáng kể, giống như tự thay lốp xe vậy.

Điều thú vị là bạn có thể thay đổi cách AI phản hồi bằng cách cung cấp cho nó các lệnh văn bản. Add-on chuyển văn bản thành giọng nói không “thông minh”, nó đọc chính xác những gì nó nhận được. Nhưng bằng cách chỉ dẫn cho Ollama về điều này, AI sẽ tạo ra văn bản tốt hơn để chuyển đổi. Ví dụ, thay vì đọc 14:22 là “một-bốn-hai-hai”, nếu bạn yêu cầu AI điều chỉnh, nó sẽ thay đổi đầu ra thành “hai giờ hai mươi hai phút chiều”, mang lại phản hồi tự nhiên hơn. Đây là một cái nhìn hấp dẫn về cách các chỉ dẫn hội thoại có thể “lập trình” AI.

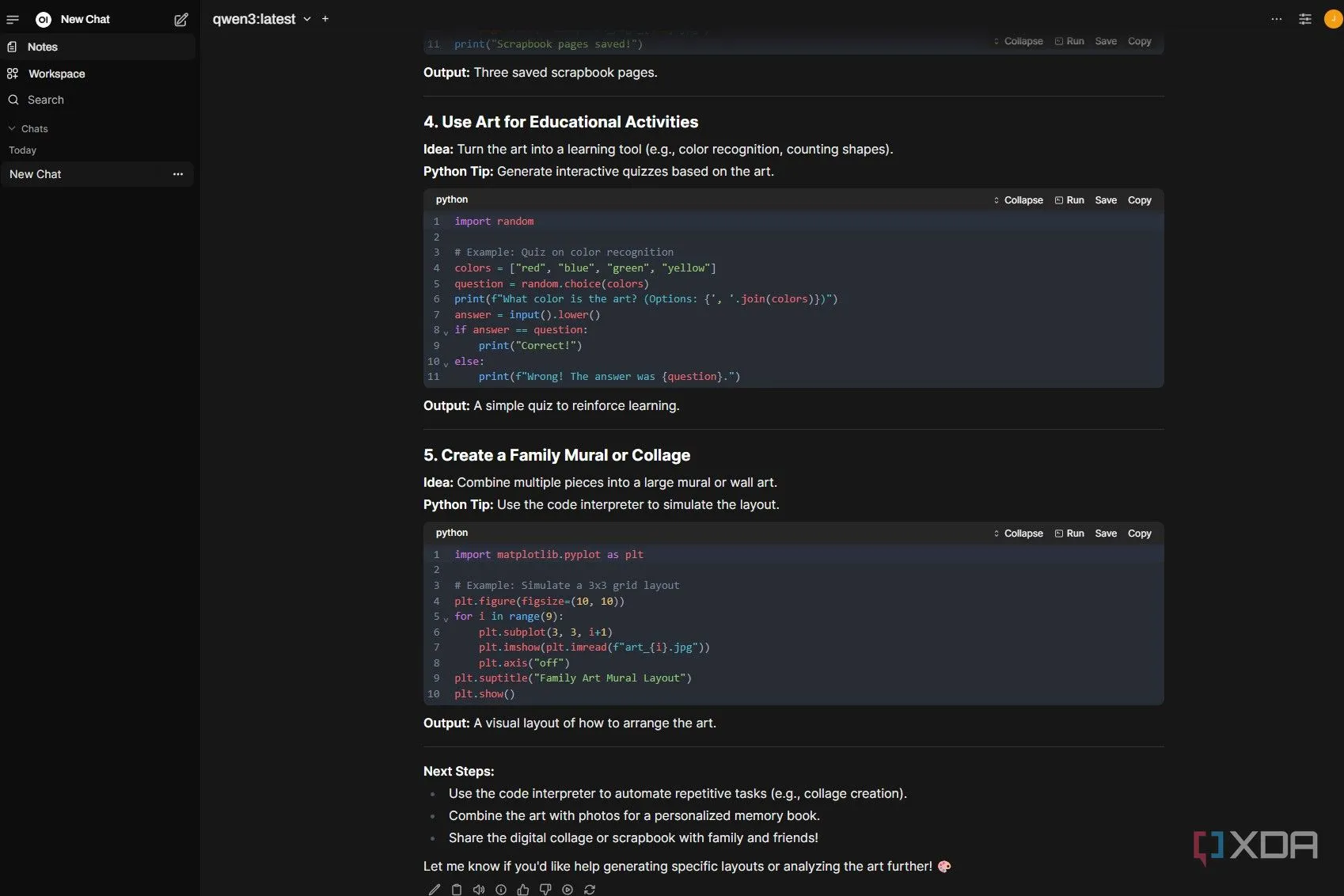

Giao diện Open UI hiển thị phản hồi của mô hình Qwen3 qua Ollama

Giao diện Open UI hiển thị phản hồi của mô hình Qwen3 qua Ollama

Mô hình ngôn ngữ lớn Orca Mini đang chạy trên Raspberry Pi 5 thông qua Ollama

Mô hình ngôn ngữ lớn Orca Mini đang chạy trên Raspberry Pi 5 thông qua Ollama

Tùy biến AI của bạn: Vượt xa những giới hạn của trợ lý ảo truyền thống

Việc sở hữu một trợ lý giọng nói cục bộ được hỗ trợ bởi Ollama không chỉ giúp bạn không còn bị ràng buộc bởi Google hay Amazon mà còn mang lại niềm vui lớn. Bạn không cần phải chấp nhận phong cách cứng nhắc, khách sáo của các mô hình AI từ tập đoàn. Bạn có thể “huấn luyện” AI của mình trở nên hài hước, mỉa mai, hoặc giới hạn lượng thông tin không cần thiết mà nó trả về khi bạn chỉ muốn tắt đèn. Điều này làm cho AI thực sự là của riêng bạn, và những nỗ lực để tìm hiểu cách chạy mô hình và kết nối mọi thứ đã thực sự đáng giá.

Kết luận

Việc xây dựng một trợ lý giọng nói AI cục bộ với Home Assistant bằng Ollama, Whisper và Piper mang lại những lợi ích vượt trội về quyền riêng tư và khả năng tùy biến. Bạn không chỉ có quyền kiểm soát hoàn toàn dữ liệu của mình mà còn có thể định hình tính cách và cách thức tương tác của AI theo ý muốn, tạo nên một trải nghiệm nhà thông minh thực sự cá nhân hóa. Mặc dù có thể còn chậm hơn các trợ lý ảo đám mây, nhưng sự tự do và tiềm năng phát triển của hệ thống cục bộ này là vô cùng hứa hẹn.

Bạn đã sẵn sàng biến ngôi nhà của mình trở nên thông minh và cá tính hơn với trợ lý giọng nói AI cục bộ chưa? Hãy bắt đầu thử nghiệm và chia sẻ trải nghiệm của bạn dưới phần bình luận nhé!